今回は動画生成AIに関する話題で

高品質な動画を生成できるモデル「LTX-Video」の導入方法と使い方

を丁寧に解説していく内容となっております。

動画生成AIというと最近ではOpenAIのSoraを筆頭に高品質な動画を生成できるサービスが色々と登場するようになりました。ただしそれらは現状Webサービスとして提供されており、しかも有料のものがほとんどということで「好きな動画をローカルで無料で生成しまくりたいんだけど…」と思っている方もいらっしゃるのではないでしょうか。

そんな中で先月あたりから海外ローカル民の間で話題になっているのが、高品質な動画を生成できる「LTX-Video」というモデルです。このモデルはComfyUI上で動かせるようだったので私も試してみることにしました。

ここではこのLTX-Videoの導入方法と使い方について詳しく書いていきますね。

LTX-Videoについて

公式ページ

LTX-Videoとは?

LTX-VideoはLightricks社が開発したオープンソースの動画生成用モデルです。768x512pxの解像度で24FPS・10秒程度の高品質な動画を素早く生成できるのが特徴で、ComfyUIを使えばローカルで比較的簡単に動かすことができます。

なお私が試した限りではText-to-Video(テキストから動画生成)のクオリティは正直悪かったのですが、Image-to-Video(画像から動画生成)のクオリティは割と高かったので予め動かしたい画像を用意してから動画を生成するのがいいと思います。

ローカルで動かす際に必要なPCスペック

お使いのPCに「12GB以上のVRAMを搭載したNVIDIAのグラフィックボード」があれば十分動作します。海外ローカル民の情報ではVRAM8GBのグラボでも動作したという報告もあるので、比較的省VRAMで動作するようです。

サンプル動画(Image to Videoの場合)

ではこの辺でLTX-Videoを使って私が画像を元に生成した動画を掲載しておきます。

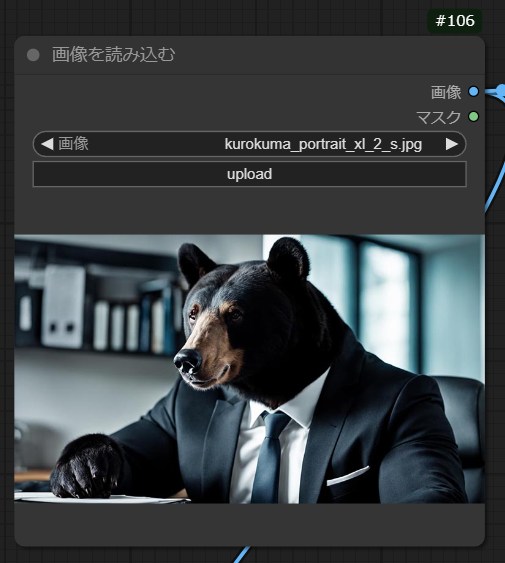

入力画像は次のとおり。

若干違和感はあるものの、入力画像の雰囲気を残しつつきちんと動画になっている印象ですね。

ちなみに私の環境(RTX 3060 12GB)では生成時間はステップ数25・フレーム数105で3分くらいでした。

LTX-Videoの導入方法(ComfyUI)

さてここからが本題でLTX-Videoの導入方法を解説していきます。主な手順は次のとおり。

- ComfyUIをインストールする

- LTX-Videoモデルをダウンロードする

- テキストエンコーダをダウンロードする

- LTX-Video用のワークフローを導入する

- 必要なカスタムノードをインストールする

それぞれ詳しく見ていきましょう。

手順1:ComfyUIのインストール

まず前提として、LTX-Videoをローカルで手軽に動かすには専用のツールが必要です。画像生成AIを使っている方ならお馴染みのComfyUIというツールが一番やりやすいので、今回はこのツールを使うことを前提とさせていただきます。

まだComfyUIをインストールしてないよという方は(少し古いですが)下記の記事で詳しいインストール方法などを解説していますので併せてご覧ください。

また、最近ではインストール・操作がより簡単な「ComfyUI Desktop」というデスクトップ版があるのでそちらをインストールして頂いてもいいでしょう。

お好きなほうを選んでください。

なお下記ではデスクトップ版の場合のやり方を解説しています(やり方自体はWebUI版もほぼ同じだと思います)。

手順2:LTX-Videoモデルのダウンロード

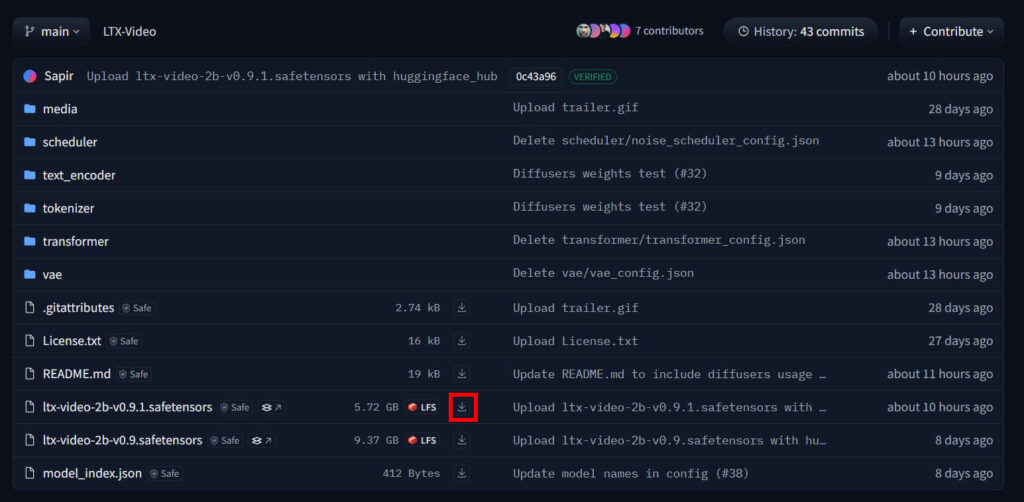

次にLTX-VideoモデルをHugging Faceからダウンロードしましょう。執筆時点の最新バージョンはv0.9.1です。

ダウンロードできたらこれを下記のフォルダに移動させてください。

ComfyUI\models\checkpoints

手順3:テキストエンコーダのダウンロード

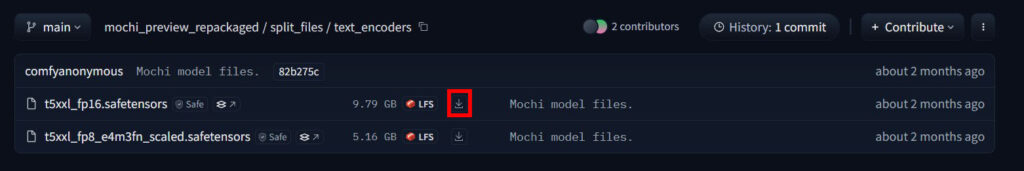

それからテキストエンコーダも必要なので下記ページからダウンロードしてください。

ダウンロードできたらこれを下記のフォルダに入れましょう。

ComfyUI\models\clip

手順4:LTX-Video用のワークフローを導入

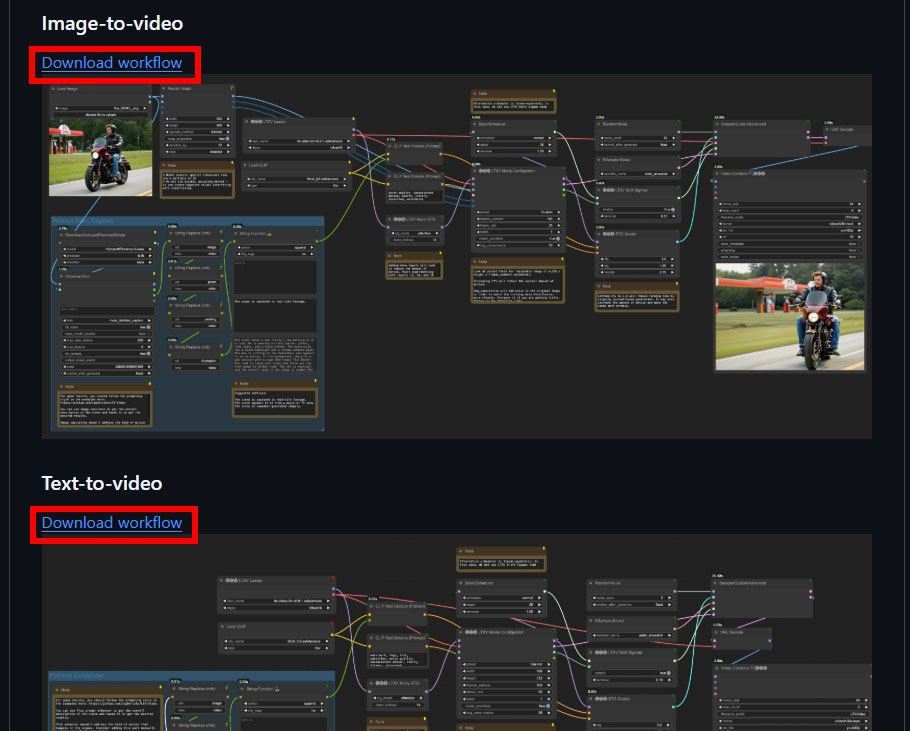

そうしたらLTX-Video用のComfyUIワークフローを導入します。ワークフローとは生成処理の流れを定義した設計図のようなものです。下記ページの下のほうにImage-to-video用とText-to-video用のワークフロー(Json形式)があるのでそれぞれダウンロードしましょう。

JsonファイルをダウンロードできたらそれをComfyUIに読み込みます。メニューバーの「ワークフロー」→「開く」からダウンロードしたファイルを開いてください。開くファイルはどちらのワークフローのものでも構いませんが、Image-to-video用のほうがオススメなのでとりあえずそっちのほうを開いておいてください。

手順5:必要なカスタムノードのインストール

ワークフローを読み込むとエラーが出ると思います。これはカスタムノードという標準ではないノードを使用しているためです。そこで必要なカスタムノードをインストールしていきます。

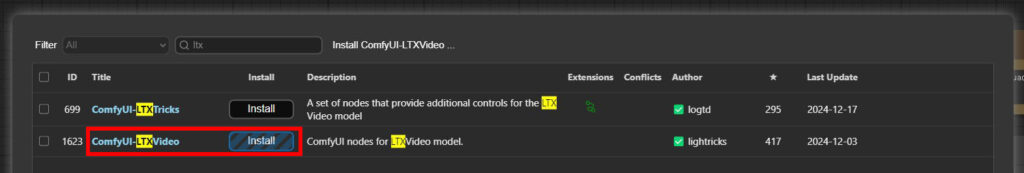

ComfyUI-LTXVideo

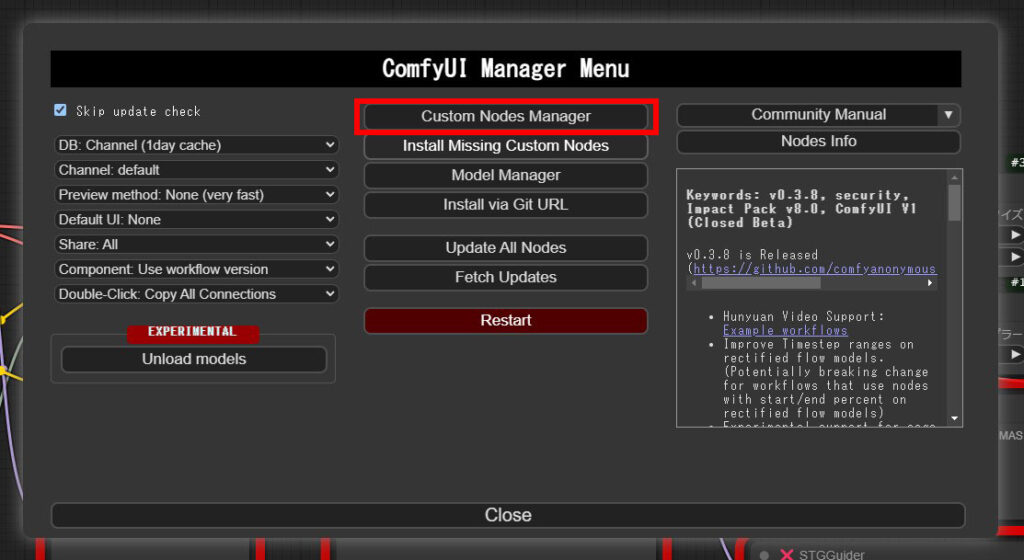

まずはLTX-Video用のカスタムノードをインストールします。画面右上の「Manager」ボタンを押すと「ComfyUI Manager Menu」というウィンドウが開きます。その中の「Custom Nodes Manager」ボタンを押しましょう。

そしてウィンドウ上部の検索バーに「ltx」と入力すると「ComfyUI-LTXVideo」という名前のものが出てきますのでそれをインストールしてください。

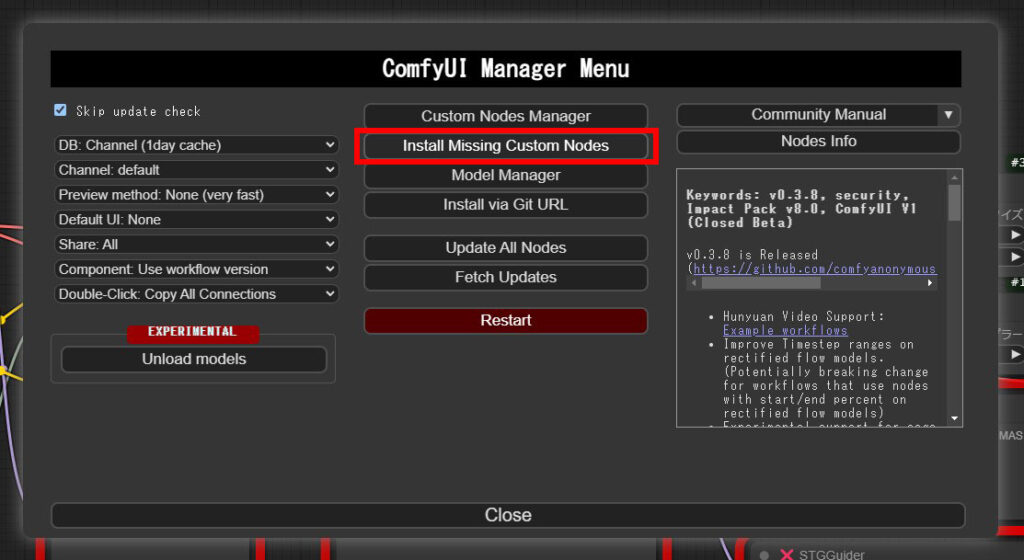

その他のカスタムノード

次に、それ以外のカスタムノードは先ほどのComfyUI Manager Menuから必要なものを一括インストールできます。ComfyUI Manager Menuの「Install Missing Custom Nodes」ボタンを押しましょう。

すると足りないカスタムノードの一覧が表示されるので一つずつインストールし、全部インストールし終わったらComfyUIを再起動してください。

お疲れさまでした。これでLTX-Videoを使うための準備が整いました!

LTX-Videoの使い方

さて準備はできましたが、ComfyUIに慣れていない方はどこを設定したら目当ての動画を生成できるのかがよく分からないと思います。そこでここでは設定が必要なノードについて解説していきます。

画像から動画を生成する方法

まずは画像から動画を生成する方法(Image-to-Video)についてです。最初のほうにも書きましたがLTX-Videoではこちらの方がよい結果を得られるので断然オススメです。動かしたい入力画像を用意してからお試しください。

ワークフローの変更が必要なところ

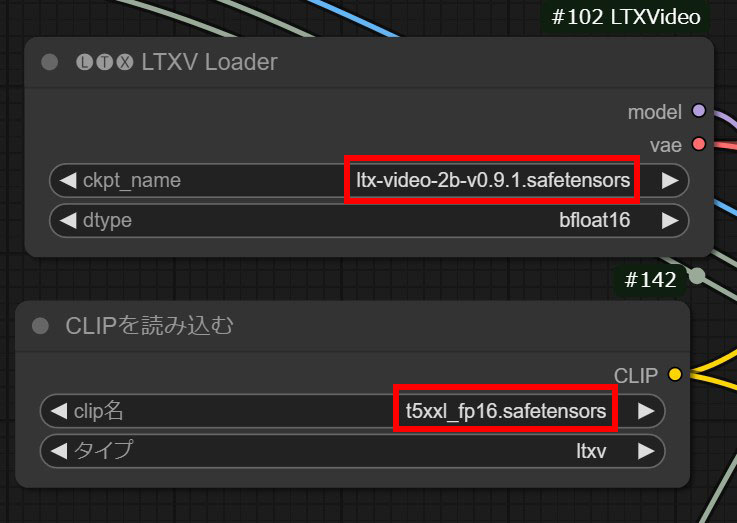

はじめに下記のノードでモデルが先ほどダウンロードしたものと合っているかどうかを確認します。

おそらく「Clip名」のところはそのままだと違うものが入っていると思いますので、矢印を押してダウンロードしたモデルに切り替えてください。

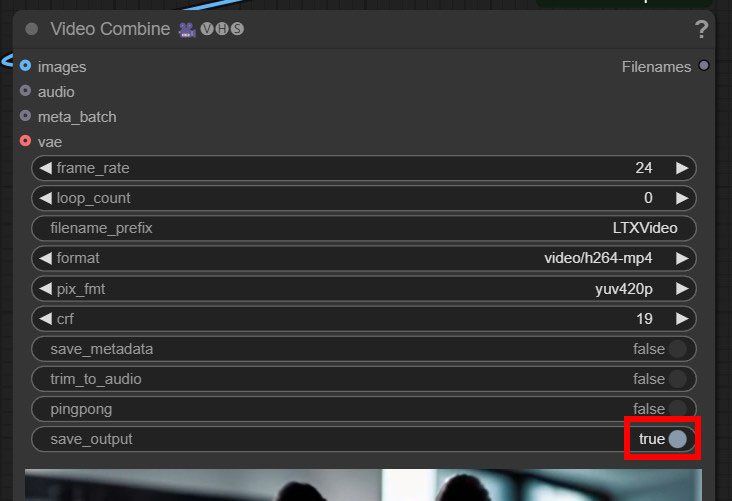

次に、そのままでは生成した動画が保存されない設定になっているので下記ノードの「save_output」をtrueにしておきましょう。

これで生成された動画が下記フォルダに保存されるようになります。

ComfyUI\output

画像のアップロード方法

入力画像をアップロードする方法は、ワークフロー左上の「画像を読み込む」というノードの「upload」ボタンを押して任意の画像を選択するだけです。

任意で調整してもよいノード

その他、お好みで調整してもよいノードとその設定値は次のとおりです。

- 基本スケジューラーノードの「ステップ」

- ランダムノイズノードの「ノイズノード」・「control_after_generate」

- LTXV Model Configuratorノードの「frames_number」・「frame_rate」

- STG Guiderノードの「cfg」(※3~3.5くらいが推奨値だそうです)

基本的に画像生成と似たような感じなのでここでは詳しい説明は省略します。お好きなように調整してみてください。

テキストから動画を生成する方法

お次はテキストから動画を生成する方法(Text-to-Video)についてです。こちらはあまり良い結果にならないかもしれませんが試してみたいよという方は是非やってみてください。

ワークフローの変更が必要なところ

先ほどと同様に

- モデルの指定

- 生成した動画が保存されるように設定を変更

を行ってください。

プロンプトの入力方法

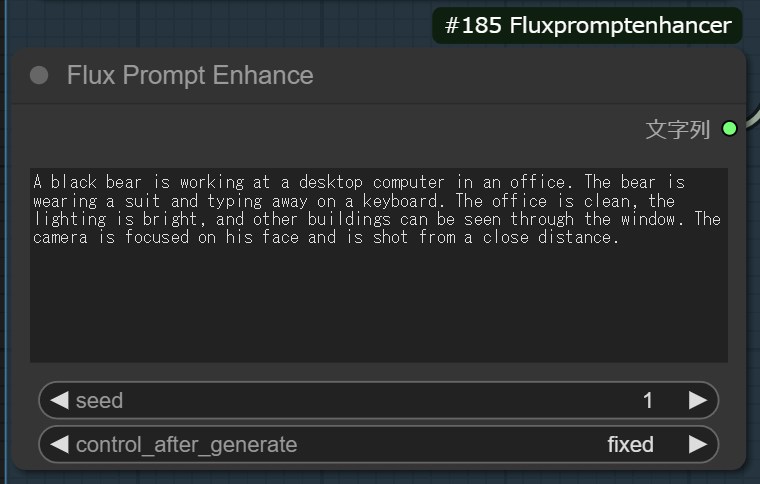

プロンプトは「Flux Prompt Enhance」ノードに英語で記入します。

プロンプトの書き方は生成したい動画についてなるべく詳しく書くのがよいそうです。画像生成のように情景について記述するのはもちろんですが、動画の場合はカメラの映し方や被写体の動き方なんかも書いておくと希望通りになりやすい…らしいです。

ちなみに今回使用しているワークフローでは、このプロンプトはそのまま使われるのではなくAIによる補正が行われてより詳しい記述になるように加工されます。その過程で思っていたのとは違うプロンプトになってしまうことがある点には注意してください。

任意で調整してもよいノード

お好みで調整してもよいノードとその設定値は次のとおりです。

- 基本スケジューラーノードの「ステップ」

- ランダムノイズノードの「ノイズノード」・「control_after_generate」

- LTXV Model Configuratorノードの「frames_number」・「frame_rate」・「width」・「height」

- STG Guiderノードの「cfg」

おわりに

以上、動画を生成できるLTX-Videoの導入方法から使い方までを一通りご紹介しました。画像を動画にできるのは楽しいのでぜひ皆さんもLTX-Videoを試してみてください。

この記事が動画生成のお役に立てば幸いです。