今回は動画生成AIに関する話題で

音声つきの動画を生成できる「LTX-2.3」の導入方法・使い方

をわかりやすく丁寧に解説するという内容になっております。

最近はローカル環境で動く動画生成AIがかなり進歩しており、以前ご紹介した「Wan2.2」などかなり高品質な動画を生成できるようになってきています。ローカルで動かせる動画生成AIというと従来は無音で動画だけを生成できるという感じでしたが、2026年初頭になってついに音声つきの動画を生成できる「LTX-2」が公開されました。そしてそのアップデート版である「LTX-2.3」が先日リリースされたとのことで私も試してみることにしました。

ここではこのLTX-2.3について導入方法や使い方を解説していきますね。

LTX-2.3について

公式サイト

LTX-2.3とは?

LTX-2.3はLightricks社が開発した動画生成AIです。

高解像度の音声つき動画を最大20秒まで生成できるのが特徴で、モデルが無料公開されており一定以上のスペックのPCをお持ちの方なら誰でもローカル環境で動かして動画を生成することができます。

ローカル環境で動かす際に必要なPCスペック

LTX-2.3は巨大なモデルとなっており、ローカル環境で動かすには一定のPCスペック(ミドルクラス以上)が必要です。動作には最低限

- VRAM12GB以上のグラフィックボード

- RAM(メインメモリ)32GB以上

- ストレージに40GB程度の空き容量

が必要になるので試してみたい!という方は予めお使いのPCのスペックを確認しておきましょう。

なお執筆時点では(AI特需のせいか)グラフィックボードやメモリが異様に高騰しており、在庫も少なくなっているようなのでスペックが足りない!という方は今は試すのを諦めたほうがいいかもしれません(導入に時間がかかるので時間を浪費してしまう可能性があります)…。

LTX-2.3で生成したサンプル動画(音声つき、画像から動画生成の場合)

次に、私が実際にLTX-2.3で生成した動画をご覧ください。LTX-2.3では

- テキストから動画(t2v)

- 画像から動画(i2v)

- 動画から動画(v2v)

といった色々な生成方法に対応しているのですが、ここでは最も品質が安定する「画像から動画生成」を試した結果を掲載します。

サンプル1:スーツを着た黒い熊が「くろくまそふと」についてプレゼンする動画

元画像

生成された動画(音声つき)

プロンプト:

A black bear in a suit is giving a presentation about a technology blog called "KurokumaSoft" in a clean, white office. When the bear's presentation is over, the camera dollies out to show businessmen applauding the bear.以前Wan2.2でも同じ画像から動画生成を試しましたが、こちらのほうが高品質な動画が生成されました!短い尺の中でもきちんと必要な音声やシーンが含まれていていいですね。

サンプル2:美味しそうにラーメンを食べるくろくまちゃん

元画像

生成された動画(音声つき)

プロンプト:

A girl wearing a black hoodie is eating ramen at a Japanese ramen restaurant with great relish.うちの美少女フィギュア風キャラクター「くろくまちゃん」がラーメンを食べている様子を動画化してみました。ただLTX-2.3は美少女フィギュア風の動画を生成するのはあまり得意ではないようで、何度か試してみましたが顔が大きく崩れてしまうなど品質が安定しないことが多かったです。

LTX-2.3の導入方法(ComfyUI)

ではここからが本題でLTX-2.3の導入方法を解説していきます。LTX-2.3を手っ取り早く動かすには「ComfyUI」という画像・動画生成ツールを使うのがベストなので、ここではComfyUIを使った導入方法をご紹介しますね。主な手順は次の通り。

- ComfyUIをインストールする(※既に導入済みの場合はアップデート推奨)

- 必要なモデル一式をダウンロードする

- モデルを適切なフォルダに入れる

- ワークフローを読み込む

- カスタムノードをインストールする

それぞれ詳しく見ていきましょう。

手順1:ComfyUIのインストール(※導入済みならアップデート推奨)

まず「ComfyUIってなに?」とか「まだComfyUIをインストールしてないよ」という方は下記の記事を参考にしてインストールを行ってください。

ComfyUIとは簡単に言うと画像生成AIや動画生成AIを動かせる強力なツールです。新しいAIにすぐ対応してくれるので最新のAIを試したい!という新しいもの好きな方なら現状はコレ一択といっても過言ではありません。AIをローカル環境で動かすならとりあえず入れておいて損はないでしょう。

なお既にComfyUIを導入済みの方はアップデートを行っておくと安心です。

手順2:必要なモデル一式をダウンロード

次にLTX-2.3の動作に必要なモデル一式をダウンロードします。ただしLightricks社が提供している公式モデルはかなりのマシンパワーを必要とするため、ここでは有志の方が作成した省VRAMで動作する量子化モデル(GGUF形式)を使うことにします。

- LTX-2.3本体

https://huggingface.co/vantagewithai/LTX-2.3-GGUF/blob/main/dev/ltx-2-3-22b-dev-Q4_K_M.gguf - LoRA

https://huggingface.co/Kijai/LTX2.3_comfy/blob/main/loras/ltx-2.3-22b-distilled-lora-dynamic_fro09_avg_rank_105_bf16.safetensors - テキストエンコーダー

https://huggingface.co/Comfy-Org/ltx-2/blob/main/split_files/text_encoders/gemma_3_12B_it_fp4_mixed.safetensors - デュアルクリップコネクター

https://huggingface.co/Kijai/LTX2.3_comfy/blob/main/text_encoders/ltx-2.3_text_projection_bf16.safetensors - VAE(動画用)

https://huggingface.co/Kijai/LTX2.3_comfy/blob/main/vae/LTX23_video_vae_bf16.safetensors - VAE(音声用)

https://huggingface.co/Kijai/LTX2.3_comfy/blob/main/vae/LTX23_audio_vae_bf16.safetensors - アップスケーラー

https://huggingface.co/Lightricks/LTX-2.3/blob/main/ltx-2.3-spatial-upscaler-x2-1.0.safetensors

ファイルサイズが巨大なモデルを複数ダウンロードすることになるので、お使いのネット回線の速度にもよりますがかなり時間がかかります。

手順3:モデルを適切なフォルダに入れる

さて必要なモデルをダウンロードできたら、それぞれComfyUI内の下記フォルダに移動させましょう。

LTX-2.3本体:

models\diffusion_modelsLoRa:

models\lorasテキストエンコーダー:

models\clipデュアルクリップコネクター:

models\text_encodersVAE2種:

models\vaeアップスケーラー:

models\latent_upscale_models手順4:ワークフローの読み込み

ここまでできたらComfyUIを起動してワークフローを読み込みます。今回使う量子化モデル用のワークフロー(画像から動画生成)は下記で有志の方が公開しているので、圧縮ファイルをダウンロードして中身のJsonファイル(LTX2.3 I2V GGUF 12GB.json)をComfyUIの画面にドラッグ&ドロップしてください(※なお下記サイト「civitai」には大人向けのAI生成コンテンツが含まれるので直接リンクしないようにしておきます)。

https://civitai.com/models/2443867?modelVersionId=2747788手順5:カスタムノードのインストール

すると多くの方の場合「ノードが見つかりません」的なエラーが出ると思いますので、下記のカスタムノード「KJNodes」をインストールしてください。

ComfyUIのデスクトップ版をお使いの場合は、画面右上の「拡張機能の管理」を押すと出るカスタムノードマネージャーで検索すれば出てくるのですぐインストールできます。

LTX-2.3の使い方(画像から動画生成するやり方)

ではいよいよLTX-2.3で動画を生成してみましょう。画像から動画生成するには、あらかじめ用意しておいた画像を下記の「画像を読み込む」ノードにドラッグ&ドロップし…

「プロンプト」ノードにプロンプトを記入して青い「実行する」ボタンを押すだけです。

生成に必要な時間はお使いのPCの性能や設定にもよりますが、私の環境では例えば5秒の動画を生成するのに5分程度かかりました。

解像度・動画の長さなどの設定方法

LTX-2.3では最大で4K解像度・20秒までの動画を生成できます。ただし当然ながらお使いのPCスペックによってはそんな動画を生成するとものすごく時間がかかったり、エラーが出て生成できないなんてことになったりするのでPCの性能に見合った設定にすべきです。

そこで生成する動画の解像度や長さの調整方法を押さえておきましょう。

動画の解像度

まず動画の解像度は「Video Settings」グループ内にある「空の画像」ノードの幅と高さをそれぞれ変更すればOKです。

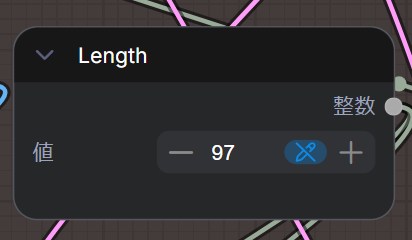

動画の長さ

次に動画の長さを変更するには同じく「Video Settings」グループ内にある「Length」ノードの値を変更します。ただし、この値は何でもいいわけではなく「8で割り切れる数+1」を設定する必要があります。

ところで動画の長さ(=何秒の動画か)は

フレーム数÷フレームレート

で求められます(フレームレートは1秒あたりのフレーム数です)。先ほどのLengthノードの値はフレーム数なので、欲しい動画の長さを決めるにはフレームレートも決める必要があります。

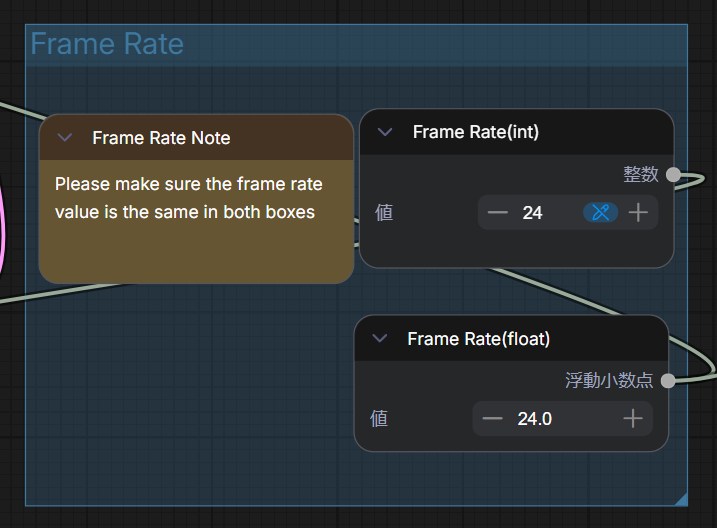

フレームレートは「Frame Rate」グループ内の2つのノードで設定します。

コメントにもある通り、この2つには同じ値を入力してください。なおデフォルトは「24」で映画と同じくらいのフレームレートになっています。

これで動画の長さを求められます。例えば96フレーム・フレームレート24なら96÷24で4秒の動画が生成されるというわけですね。

プロンプトガイド

高品質な動画を生成するためにLTX-2公式サイトのプロンプトガイドを読むことをおすすめします。どのようなプロンプトを書けばいいのかが具体的なサンプル付きで掲載されているのでぜひご一読ください。

おわりに

以上、音声付きの動画を生成できるLTX-2.3の導入方法や使い方をご紹介しました。音声付きの動画をローカル環境で本格的に生成できる動画生成AIは今までなかったのでとても新鮮で面白いですね。皆さんもぜひこの機会に試してみてください。

この記事が動画生成のお役に立てば幸いです。